(23.03.18)

binary classification -> logistic regression

multi-class classification -> softmax regression

logistic regression 관련 코드 구현한 것 ><

https://github.com/gompaang/machine_learning_practice/blob/main/code/logistic_regression.ipynb

GitHub - gompaang/machine_learning_practice

Contribute to gompaang/machine_learning_practice development by creating an account on GitHub.

github.com

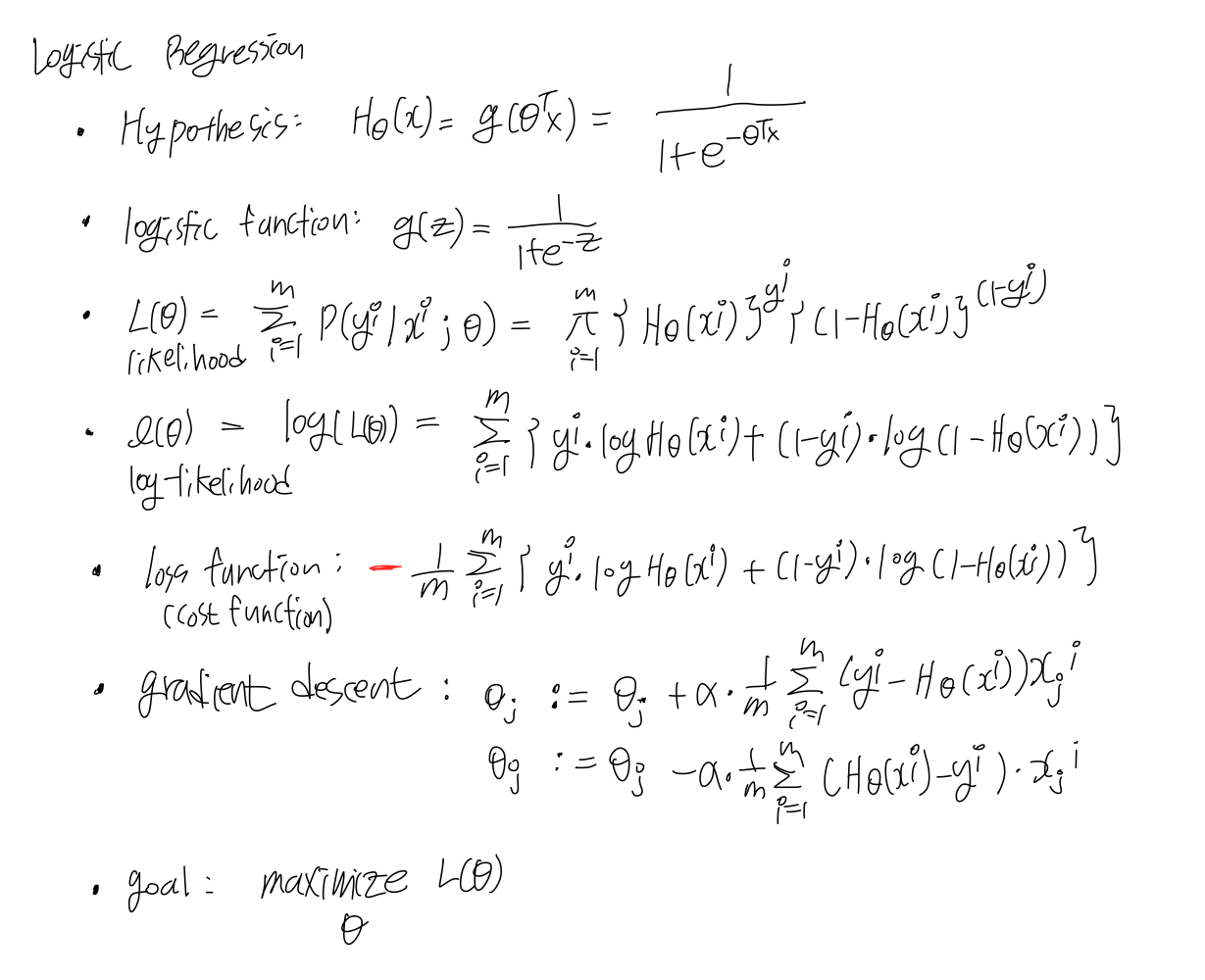

Logistic Regression

- logistic regression은 binary classification을 수행한다.

- sigmoid function은 y값이 0과 1사이로 나타나는데, logistic regression의 hypothesis function을 0과 1사이의 값을 가지는 logistic function으로 정의한다. 이 가설 함수는 feature가 어떤 x를 가질 때, y=0 또는 y=1 이 되는 확률을 의미한다.

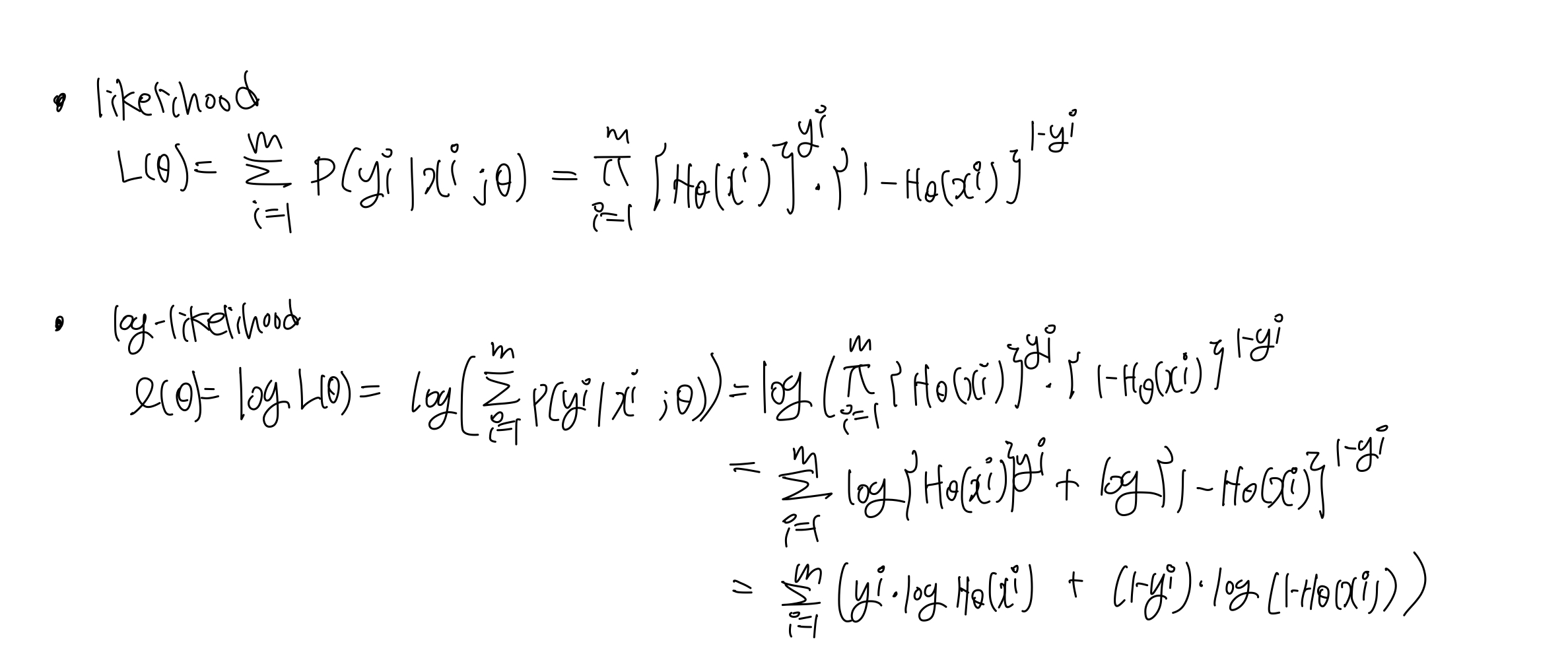

- logistic regression은 likelihood 를 최대화하는 parameter를 찾는 것이 최종 목표이다. likelihood를 계산하면 아래와 같다.

- likelihood에 log를 취한 것을 log-likelihood라고 한다.

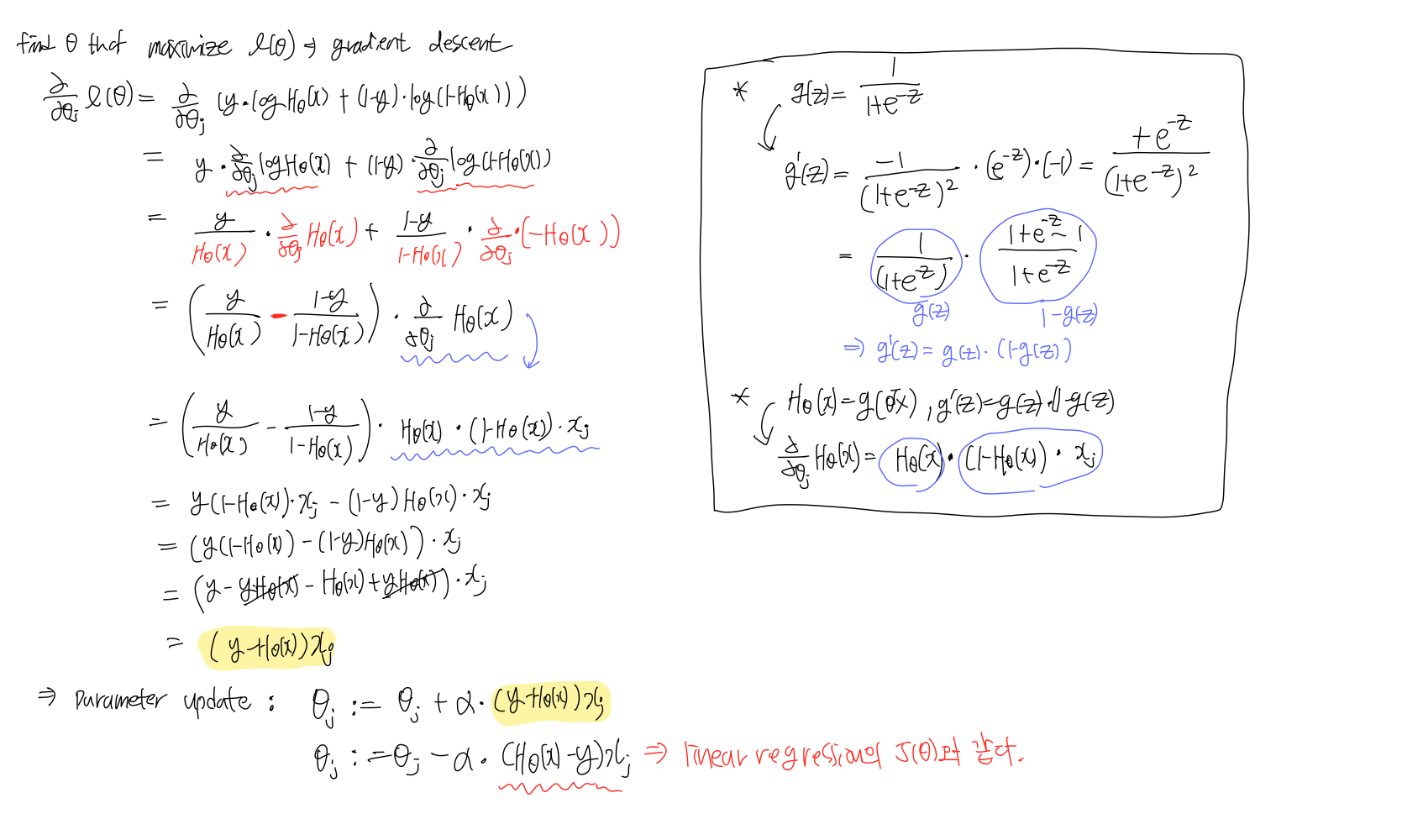

- log-likelihood를 최대화하는 값을 찾으면 되는데, 이때도 linear regression 때와 마찬가지로 gradient descent를 사용하여 계산한다. 계산과정은 아래와 같다.

logistic regression 수식 정리

Newton's method

- 함수 f(x)에 대해서 함숫값이 0이 되도록 하는 x를 찾는 방법이다.

- feature 수가 적을 때, gradient descent 보다 빠르게 계산할 수 있는 방법이다. 자세한 설명은 아래 그림으로~